전략적 사고를 활용한 프롬프트 엔지니어링

AI를 사용할 때 많은 사람은 이렇게 질문한다.

이 주제에 대해 알려줘. 이 문제를 해결해줘. 블로그 글을 써줘.

이런 방식도 어느 정도 작동한다. 하지만 복잡한 문제에서는 결과가 뻔하거나 얕아지는 경우가 많다. AI에게 무엇을 해야 하는지만 말하고, 어떤 방식으로 생각해야 하는지는 알려주지 않았기 때문이다.

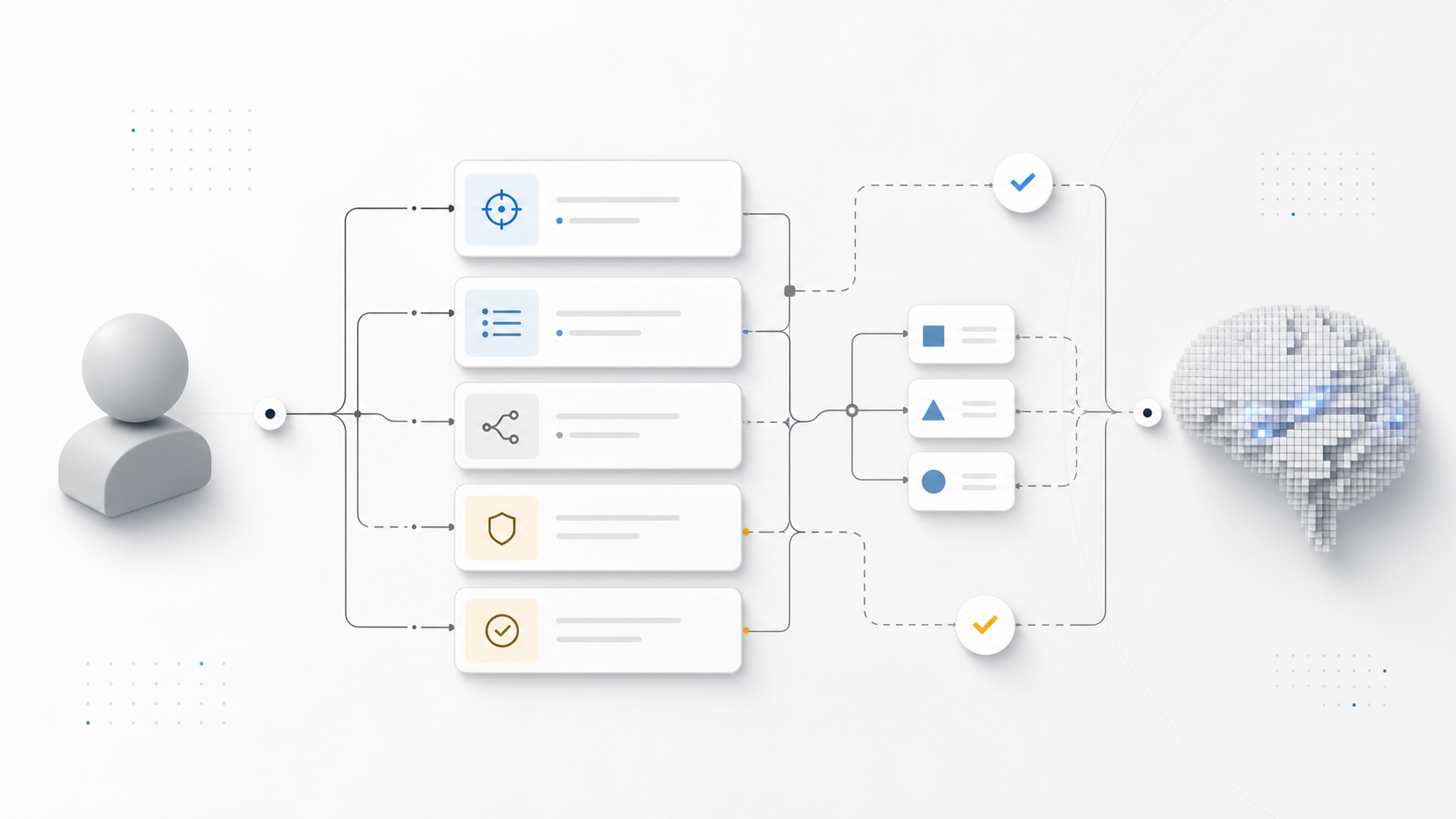

최근 프롬프트 엔지니어링의 중요한 흐름은 단순한 명령어 작성이 아니라, 전략적 사고와 문제 해결 방법론을 프롬프트 안에 녹이는 것이다. AI에게 “정답만 말해줘”가 아니라 “문제를 정의하고, 기준을 세우고, 대안을 비교하고, 검증한 뒤 답해줘”라고 요청하는 방식이다.

OpenAI의 공식 프롬프트 엔지니어링 가이드도 좋은 결과를 얻기 위한 방법으로 명확한 지시, 참고자료 제공, 복잡한 작업의 하위 작업 분해, 모델에게 생각할 시간 주기, 외부 도구 사용, 변경사항의 체계적 테스트를 제안한다. 이는 전략적 사고의 구조를 프롬프트에 적용하는 접근과 맞닿아 있다.

전략적 사고 기반 프롬프트란 무엇인가

전략적 사고 기반 프롬프트는 AI에게 단순히 결과물을 요청하는 것이 아니라, 문제를 바라보는 프레임을 함께 제공하는 프롬프트다.

일반적인 프롬프트는 다음과 같다.

이 서비스 아이디어를 평가해줘.전략적 사고 기반 프롬프트는 이렇게 바꿀 수 있다.

다음 서비스 아이디어를 전략적 관점에서 평가해 주세요.

1. 이 아이디어가 해결하려는 핵심 문제를 정의해 주세요.

2. 주요 고객과 이해관계자를 정리해 주세요.

3. 시장성, 기술적 난이도, 수익성, 리스크를 각각 평가해 주세요.

4. 실행 가능한 MVP를 제안해 주세요.

5. 이 아이디어가 실패할 가능성이 높은 이유도 함께 제시해 주세요.

아이디어:

[내용 입력]두 프롬프트의 차이는 분명하다. 첫 번째는 AI에게 “평가”라는 막연한 작업을 맡긴다. 두 번째는 평가 기준, 사고 순서, 검토 항목, 반론까지 함께 지시한다.

핵심은 AI를 단순한 답변 생성기가 아니라, 문제 해결 프로세스를 따라 움직이는 협업 도구처럼 사용하는 것이다.

왜 효과가 있을까

LLM은 사용자의 의도를 완벽하게 알아서 해석하지 않는다. 사용자가 제공한 지시, 맥락, 예시, 제약조건에 따라 출력을 구성한다. 따라서 복잡한 문제일수록 어떤 기준으로 판단할지, 어떤 순서로 사고할지를 명확히 알려주는 것이 중요하다.

대표적인 연구가 Chain-of-Thought Prompting이다. 이 연구는 모델이 중간 추론 단계를 생성하도록 유도하면 산술, 상식, 기호 추론 같은 복잡한 문제에서 성능이 향상된다고 설명한다. 특히 충분히 큰 모델에서 효과가 두드러진 것으로 보고되었다.

프롬프트에 사고 절차를 넣는 것은 단순한 말장난이 아니다. 복잡한 문제를 작은 단계로 나누고, 각 단계에서 판단하도록 만드는 방식은 실제 연구에서도 효과가 확인된 접근이다.

대표적인 전략적 프롬프트 방법론

1. Chain-of-Thought: 단계적으로 사고하게 하기

Chain-of-Thought는 AI에게 문제를 한 번에 풀게 하지 않고, 중간 단계를 거쳐 답하도록 유도하는 방식이다.

다음 문제를 바로 답하지 말고, 필요한 정보를 정리한 뒤 단계적으로 풀어 주세요.

마지막에는 최종 답만 따로 정리해 주세요.이 방식은 수학 문제, 논리 문제, 원인 분석, 복잡한 비교 작업에 적합하다. Google Research도 Chain-of-Thought가 다단계 문제를 중간 단계로 분해하도록 만들어 reasoning 능력을 개선한다고 설명한다.

다만 실무에서는 “모든 사고 과정을 길게 보여줘”보다 “단계별로 검토하고 결론과 근거를 요약해줘”가 더 낫다. 장황한 추론 과정은 읽기 어렵고, 때로는 그럴듯하지만 틀린 설명을 만들 수 있기 때문이다.

2. Self-Consistency: 여러 경로로 검토하고 일관된 결론 찾기

Self-Consistency는 하나의 답변만 받지 않고, 여러 풀이 경로나 관점을 만든 뒤 가장 일관된 결론을 선택하는 방식이다.

이 문제를 서로 다른 접근법 3가지로 검토해 주세요.

각 접근법의 결론을 비교하고, 가장 일관된 결론을 최종 답으로 제시해 주세요.Self-Consistency 연구는 다양한 reasoning path를 샘플링한 뒤 가장 일관된 답을 선택하는 방식이 복잡한 추론 벤치마크에서 성능을 높였다고 보고했다. 논문에서는 GSM8K, SVAMP, AQuA, StrategyQA, ARC-challenge 등에서 성능 향상이 나타났다.

실무에서는 버그 원인 추정, 기획안 검토, 정책 해석, 의사결정 검토에 유용하다. 하나의 관점으로 나온 답보다 여러 관점을 비교한 답이 더 안정적일 가능성이 높다.

3. Tree of Thoughts: 여러 선택지를 탐색하고 평가하기

Tree of Thoughts는 하나의 사고 흐름만 따라가는 Chain-of-Thought보다 더 탐색적인 방식이다. 여러 후보 경로를 만들고, 각 경로를 평가한 뒤 가능성이 높은 경로를 더 깊게 탐색한다.

이 문제를 Tree of Thoughts 방식으로 분석해 주세요.

1. 가능한 해결 전략을 3가지 제시해 주세요.

2. 각 전략의 장점, 단점, 리스크를 평가해 주세요.

3. 가장 가능성 높은 전략 1~2개를 더 깊게 분석해 주세요.

4. 최종 추천안을 제시하고 실패 가능성도 함께 정리해 주세요.Tree of Thoughts 논문은 기존 Chain-of-Thought가 하나의 좌우 순차적 생성 방식에 제한될 수 있다고 보고, 여러 사고 경로를 탐색하고 자체 평가하며 필요하면 되돌아가는 방식을 제안했다. 논문은 Game of 24, 창의적 글쓰기, 미니 크로스워드 같은 문제에서 효과를 보였다고 설명한다.

이 방식은 사업 전략, 서비스 기획, 기술 아키텍처 선택, 마케팅 방향 설정처럼 정답이 하나로 정해져 있지 않은 문제에 잘 맞는다.

4. ReAct: 추론과 행동을 결합하기

ReAct는 Reasoning과 Acting을 결합한 방식이다. AI가 단순히 생각만 하는 것이 아니라, 필요한 경우 검색, 문서 확인, 도구 사용 같은 행동을 수행하고 그 결과를 바탕으로 답을 업데이트한다.

다음 작업을 ReAct 방식으로 수행해 주세요.

1. 먼저 무엇을 확인해야 하는지 계획해 주세요.

2. 필요한 경우 웹 검색이나 문서 확인을 수행해 주세요.

3. 확인한 결과를 바탕으로 답변을 수정해 주세요.

4. 최종 답변에는 확인된 사실과 추정한 내용을 구분해 주세요.ReAct 연구는 reasoning trace와 task-specific action을 번갈아 생성하게 하면 모델이 계획을 세우고, 업데이트하고, 외부 지식 소스와 상호작용할 수 있다고 설명한다. 논문은 질의응답, 사실검증, 상호작용형 의사결정 작업에서 효과를 보였다고 보고했다. Google Research도 ReAct가 추론과 행동을 결합해 더 해석 가능하고 제어 가능한 문제 해결 방식을 제공한다고 설명한다.

최신 정보가 필요한 리서치, 내부 문서 기반 답변, 제품 비교, 법률 및 정책 검토처럼 근거 확인이 중요한 작업에 적합하다.

실무에서 바로 쓸 수 있는 프롬프트 템플릿

전략 분석용 프롬프트

다음 주제를 전략적 사고 방식으로 분석해 주세요.

1. 핵심 문제를 한 문장으로 정의해 주세요.

2. 이해관계자와 제약조건을 정리해 주세요.

3. 가능한 전략을 3가지 제시해 주세요.

4. 각 전략의 장점, 단점, 리스크, 실행 난이도를 비교해 주세요.

5. 가장 현실적인 전략을 추천해 주세요.

6. 이 결론이 틀릴 수 있는 조건도 함께 제시해 주세요.

주제:

[입력]문제 해결용 프롬프트

다음 문제를 바로 해결하지 말고 진단부터 해 주세요.

1. 가능한 원인을 우선순위별로 나눠 주세요.

2. 각 원인을 확인하는 방법을 제시해 주세요.

3. 가장 가능성 높은 해결책부터 제안해 주세요.

4. 해결책의 부작용이나 예외 상황을 알려 주세요.

5. 마지막에 확실한 내용과 추정한 내용을 구분해 주세요.

문제:

[입력]코드 리뷰용 프롬프트

다음 코드를 시니어 프론트엔드 개발자 관점에서 리뷰해 주세요.

검토 기준:

1. 버그 가능성

2. 성능

3. 유지보수성

4. 접근성

5. 브라우저 호환성

6. 더 단순한 구현 가능성

출력 형식:

- 가장 중요한 문제 3개

- 수정 이유

- 개선 코드

- 추가 테스트 항목

코드:

[입력]리서치용 프롬프트

다음 주제를 조사해 주세요.

1. 먼저 확인해야 할 핵심 질문을 정리해 주세요.

2. 최신성과 신뢰도가 중요한 부분을 구분해 주세요.

3. 출처 기반으로 핵심 내용을 요약해 주세요.

4. 서로 다른 관점이나 반론이 있으면 함께 정리해 주세요.

5. 마지막에 실무적으로 적용 가능한 결론을 제시해 주세요.

주제:

[입력]특히 효과적인 상황

전략적 사고 기반 프롬프트는 복잡한 의사결정에 효과적이다. 기술 스택 선택, 서비스 방향 설정, 사업 아이디어 검토처럼 여러 기준을 동시에 고려해야 하는 문제에서 유용하다.

원인 분석에도 잘 맞는다. 버그, 성능 저하, 매출 감소, 사용자 이탈처럼 원인이 하나로 명확하지 않은 문제에서는 가능한 원인을 나누고 검증 순서를 정하는 방식이 도움이 된다.

기획과 전략 수립에서도 효과가 크다. 단순 아이디어 생성보다 문제 정의, 타깃 분석, 실행 우선순위, 리스크 검토가 필요한 경우에 적합하다.

리서치와 검증 작업에서는 ReAct나 RAG 방식의 프롬프트가 특히 유용하다. 최신 정보, 근거, 출처, 반론이 필요한 작업에서는 확인된 사실과 추정을 구분하도록 요청해야 한다.

코드 리뷰와 문서 검토에서도 검토 기준을 명확히 주면 AI가 더 일관된 방식으로 문제를 찾아낸다.

효과가 작은 상황

모든 프롬프트를 복잡하게 만들 필요는 없다. 단순 번역, 짧은 문장 교정, 간단한 요약, 명확한 사실 질문에는 긴 전략 프롬프트가 오히려 비효율적이다.

이 문장을 자연스러운 영어로 바꿔줘.이 정도면 충분한 작업에 굳이 문제 정의, 대안 비교, 리스크 분석까지 요구할 필요는 없다. 프롬프트 엔지니어링의 목적은 길게 쓰는 것이 아니라, 작업에 필요한 사고 구조를 정확히 제공하는 것이다.

구조가 있다고 해서 항상 맞는 것은 아니다

전략적 프롬프트는 답변의 품질을 높일 수 있지만 정확성을 보장하지는 않는다. AI는 논리적인 형식을 갖춘 틀린 답변도 만들 수 있다. 중요한 작업에서는 반드시 검증 장치를 넣어야 한다.

근거가 불확실한 내용은 추정이라고 표시해 주세요.

최신 정보가 필요한 내용은 웹 검색 기준으로 확인해 주세요.

마지막에 검증해야 할 체크리스트를 제공해 주세요.특히 법률, 의료, 금융, 보안, 기업 의사결정처럼 리스크가 큰 분야에서는 AI 답변을 그대로 믿기보다 출처 확인과 전문가 검토가 필요하다.

좋은 프롬프트의 핵심 구조

전략적 사고 기반 프롬프트는 대체로 다음 구조를 가진다.

역할:

AI가 어떤 관점에서 답해야 하는지 지정합니다.

목표:

무엇을 달성해야 하는지 명확히 합니다.

맥락:

상황, 배경, 대상, 제약조건을 제공합니다.

방법:

문제를 어떤 순서로 분석할지 지정합니다.

기준:

무엇을 기준으로 판단할지 알려줍니다.

출력 형식:

답변을 어떤 형태로 정리할지 정합니다.

검증:

불확실성, 반론, 추가 확인 사항을 요구합니다.예시는 다음과 같다.

역할:

당신은 시니어 UX 전략가입니다.

목표:

신규 웹서비스의 랜딩페이지 전략을 검토해 주세요.

맥락:

타깃 사용자는 30대 직장인이고, 서비스는 업무 자동화 도구입니다.

방법:

1. 핵심 고객 문제를 정의해 주세요.

2. 랜딩페이지에서 가장 먼저 설득해야 할 메시지를 제안해 주세요.

3. 신뢰를 만들기 위한 요소를 정리해 주세요.

4. 전환율을 높이기 위한 CTA 구조를 제안해 주세요.

기준:

명확성, 설득력, 실행 가능성, 전환율 관점에서 평가해 주세요.

출력 형식:

- 핵심 문제

- 메시지 전략

- 페이지 구성

- CTA 제안

- 테스트해야 할 가설이런 구조를 사용하면 AI의 답변이 덜 산만해지고, 실무에 적용하기 쉬운 형태로 정리된다.

결론

전략적 사고 기반 프롬프트 엔지니어링의 핵심은 AI에게 멋진 명령어를 던지는 것이 아니다. 문제를 어떻게 바라보고, 어떤 기준으로 판단하고, 어떤 방식으로 검증할지 알려주는 것이다.

Chain-of-Thought, Self-Consistency, Tree of Thoughts, ReAct 같은 방법론은 모두 같은 방향을 가리킨다. 복잡한 문제를 한 번에 해결하려 하지 말고, 문제를 나누고, 여러 경로를 검토하고, 외부 근거를 확인하고, 마지막에 검증하라는 것이다.

실무에서 AI를 잘 쓰는 사람은 단순히 질문을 잘하는 사람이 아니다. 더 정확히는 AI가 따라야 할 사고의 구조를 설계할 수 있는 사람이다. 프롬프트 엔지니어링의 진짜 가치는 여기에 있다.

When using AI, many people ask questions like this.

Tell me about this topic. Solve this problem. Write a blog post.

This works to a point. But for complex problems, the result often becomes obvious or shallow because the prompt says what the AI should do, but not how it should think.

An important direction in modern prompt engineering is not just writing commands, but embedding strategic thinking and problem-solving methods into the prompt. Instead of saying "just give me the answer," the user asks the model to define the problem, set criteria, compare alternatives, verify the result, and then answer.

OpenAI's official prompt engineering guide also recommends clear instructions, reference material, splitting complex tasks into subtasks, giving the model time to think, using external tools, and testing changes systematically. This aligns with applying the structure of strategic thinking to prompts.

What Is a Strategic-Thinking Prompt?

A strategic-thinking prompt does not merely ask AI for an output. It also gives the AI a frame for looking at the problem.

A normal prompt looks like this.

Evaluate this service idea.

A strategic-thinking prompt can turn it into this.

다음 서비스 아이디어를 전략적 관점에서 평가해 주세요.

1. 이 아이디어가 해결하려는 핵심 문제를 정의해 주세요.

2. 주요 고객과 이해관계자를 정리해 주세요.

3. 시장성, 기술적 난이도, 수익성, 리스크를 각각 평가해 주세요.

4. 실행 가능한 MVP를 제안해 주세요.

5. 이 아이디어가 실패할 가능성이 높은 이유도 함께 제시해 주세요.

아이디어:

[내용 입력]

The difference is clear. The first prompt vaguely delegates "evaluation" to the AI. The second prompt specifies evaluation criteria, order of thinking, review items, and even counterarguments.

The core idea is to use AI not as a simple answer generator, but as a collaborative tool that follows a problem-solving process.

Why Does It Work?

LLMs do not perfectly infer the user's intent on their own. They shape their output according to the instructions, context, examples, and constraints provided by the user. The more complex the problem, the more important it is to specify the criteria and the order of reasoning.

A representative study is Chain-of-Thought Prompting. It explains that encouraging models to generate intermediate reasoning steps improves performance on complex tasks such as arithmetic, commonsense, and symbolic reasoning, especially in sufficiently large models.

Putting a thinking procedure into a prompt is not wordplay. Breaking a complex problem into smaller steps and asking the model to judge each step is an approach whose effectiveness has been shown in research.

Representative Strategic Prompting Methods

1. Chain-of-Thought: Make the Model Think Step by Step

Chain-of-Thought encourages AI not to solve a problem in one jump, but to answer through intermediate steps.

다음 문제를 바로 답하지 말고, 필요한 정보를 정리한 뒤 단계적으로 풀어 주세요.

마지막에는 최종 답만 따로 정리해 주세요.

This works well for math problems, logic problems, root-cause analysis, and complex comparisons. Google Research also explains that Chain-of-Thought improves reasoning by making the model decompose multi-step problems into intermediate steps.

In practice, however, asking for "all reasoning in detail" is often less useful than asking the model to "review step by step and summarize the conclusion and evidence." Long reasoning traces are hard to read and can sometimes produce plausible but wrong explanations.

2. Self-Consistency: Review Through Multiple Paths and Find the Consistent Conclusion

Self-Consistency does not rely on a single answer. It creates multiple solution paths or perspectives and chooses the most consistent conclusion.

이 문제를 서로 다른 접근법 3가지로 검토해 주세요.

각 접근법의 결론을 비교하고, 가장 일관된 결론을 최종 답으로 제시해 주세요.

The Self-Consistency paper reported that sampling diverse reasoning paths and selecting the most consistent answer improved performance on complex reasoning benchmarks, including GSM8K, SVAMP, AQuA, StrategyQA, and ARC-challenge.

In practical work, it is useful for estimating bug causes, reviewing plans, interpreting policies, and checking decisions. An answer that compares multiple views is often more stable than one produced from a single perspective.

3. Tree of Thoughts: Explore and Evaluate Multiple Options

Tree of Thoughts is more exploratory than Chain-of-Thought, which follows one line of thought. It creates several candidate paths, evaluates each one, and explores the more promising paths more deeply.

이 문제를 Tree of Thoughts 방식으로 분석해 주세요.

1. 가능한 해결 전략을 3가지 제시해 주세요.

2. 각 전략의 장점, 단점, 리스크를 평가해 주세요.

3. 가장 가능성 높은 전략 1~2개를 더 깊게 분석해 주세요.

4. 최종 추천안을 제시하고 실패 가능성도 함께 정리해 주세요.

The Tree of Thoughts paper argues that Chain-of-Thought can be limited by a left-to-right sequential generation process, and proposes exploring multiple reasoning paths, self-evaluating them, and backtracking when needed. The paper showed effects on tasks such as Game of 24, creative writing, and mini crosswords.

This method fits problems where there is no single fixed answer, such as business strategy, service planning, technical architecture choices, and marketing direction.

4. ReAct: Combine Reasoning and Acting

ReAct combines Reasoning and Acting. The AI does not only think; when needed, it searches, checks documents, uses tools, and updates its answer based on the results.

다음 작업을 ReAct 방식으로 수행해 주세요.

1. 먼저 무엇을 확인해야 하는지 계획해 주세요.

2. 필요한 경우 웹 검색이나 문서 확인을 수행해 주세요.

3. 확인한 결과를 바탕으로 답변을 수정해 주세요.

4. 최종 답변에는 확인된 사실과 추정한 내용을 구분해 주세요.

The ReAct paper explains that alternating reasoning traces with task-specific actions lets a model plan, update its plan, and interact with external knowledge sources. It reported benefits in question answering, fact verification, and interactive decision-making. Google Research also describes ReAct as a more interpretable and controllable way to solve problems by combining reasoning and action.

It is well suited for research that needs fresh information, answers based on internal documents, product comparison, and legal or policy review where evidence checking matters.

Prompt Templates You Can Use in Practice

Strategy Analysis Prompt

다음 주제를 전략적 사고 방식으로 분석해 주세요.

1. 핵심 문제를 한 문장으로 정의해 주세요.

2. 이해관계자와 제약조건을 정리해 주세요.

3. 가능한 전략을 3가지 제시해 주세요.

4. 각 전략의 장점, 단점, 리스크, 실행 난이도를 비교해 주세요.

5. 가장 현실적인 전략을 추천해 주세요.

6. 이 결론이 틀릴 수 있는 조건도 함께 제시해 주세요.

주제:

[입력]

Problem-Solving Prompt

다음 문제를 바로 해결하지 말고 진단부터 해 주세요.

1. 가능한 원인을 우선순위별로 나눠 주세요.

2. 각 원인을 확인하는 방법을 제시해 주세요.

3. 가장 가능성 높은 해결책부터 제안해 주세요.

4. 해결책의 부작용이나 예외 상황을 알려 주세요.

5. 마지막에 확실한 내용과 추정한 내용을 구분해 주세요.

문제:

[입력]

Code Review Prompt

다음 코드를 시니어 프론트엔드 개발자 관점에서 리뷰해 주세요.

검토 기준:

1. 버그 가능성

2. 성능

3. 유지보수성

4. 접근성

5. 브라우저 호환성

6. 더 단순한 구현 가능성

출력 형식:

- 가장 중요한 문제 3개

- 수정 이유

- 개선 코드

- 추가 테스트 항목

코드:

[입력]

Research Prompt

다음 주제를 조사해 주세요.

1. 먼저 확인해야 할 핵심 질문을 정리해 주세요.

2. 최신성과 신뢰도가 중요한 부분을 구분해 주세요.

3. 출처 기반으로 핵심 내용을 요약해 주세요.

4. 서로 다른 관점이나 반론이 있으면 함께 정리해 주세요.

5. 마지막에 실무적으로 적용 가능한 결론을 제시해 주세요.

주제:

[입력]

Situations Where It Works Especially Well

Strategic-thinking prompts are effective for complex decision-making. They are useful when many criteria must be considered at the same time, such as choosing a technology stack, setting a service direction, or reviewing a business idea.

They also fit root-cause analysis. For problems such as bugs, performance drops, sales declines, or user churn, it helps to divide possible causes and set the order of verification.

They are strong for planning and strategy as well. They are useful when the work needs problem definition, target analysis, execution priorities, and risk review rather than simple idea generation.

For research and verification, ReAct or RAG-style prompts are especially useful. When freshness, evidence, sources, and counterarguments matter, ask the model to separate confirmed facts from assumptions.

For code review and document review, clear criteria make AI find issues more consistently.

Situations Where It Is Less Useful

Not every prompt needs to be complex. For simple translation, short copy editing, simple summaries, or clear factual questions, a long strategic prompt can be inefficient.

이 문장을 자연스러운 영어로 바꿔줘.

For a task like this, there is no need to require problem definition, alternative comparison, and risk analysis. The goal of prompt engineering is not to write long prompts. It is to provide the thinking structure the task actually needs.

Structure Does Not Guarantee Correctness

Strategic prompts can improve answer quality, but they do not guarantee accuracy. AI can produce wrong answers in a logical-looking form. Important work needs explicit verification.

근거가 불확실한 내용은 추정이라고 표시해 주세요.

최신 정보가 필요한 내용은 웹 검색 기준으로 확인해 주세요.

마지막에 검증해야 할 체크리스트를 제공해 주세요.

For high-risk fields such as law, medicine, finance, security, and corporate decision-making, AI answers should be checked against sources and reviewed by experts instead of being trusted as-is.

The Core Structure of a Good Prompt

A strategic-thinking prompt usually has this structure.

역할:

AI가 어떤 관점에서 답해야 하는지 지정합니다.

목표:

무엇을 달성해야 하는지 명확히 합니다.

맥락:

상황, 배경, 대상, 제약조건을 제공합니다.

방법:

문제를 어떤 순서로 분석할지 지정합니다.

기준:

무엇을 기준으로 판단할지 알려줍니다.

출력 형식:

답변을 어떤 형태로 정리할지 정합니다.

검증:

불확실성, 반론, 추가 확인 사항을 요구합니다.

Here is an example.

역할:

당신은 시니어 UX 전략가입니다.

목표:

신규 웹서비스의 랜딩페이지 전략을 검토해 주세요.

맥락:

타깃 사용자는 30대 직장인이고, 서비스는 업무 자동화 도구입니다.

방법:

1. 핵심 고객 문제를 정의해 주세요.

2. 랜딩페이지에서 가장 먼저 설득해야 할 메시지를 제안해 주세요.

3. 신뢰를 만들기 위한 요소를 정리해 주세요.

4. 전환율을 높이기 위한 CTA 구조를 제안해 주세요.

기준:

명확성, 설득력, 실행 가능성, 전환율 관점에서 평가해 주세요.

출력 형식:

- 핵심 문제

- 메시지 전략

- 페이지 구성

- CTA 제안

- 테스트해야 할 가설

Using this structure makes the AI's answer less scattered and easier to apply in real work.

Conclusion

The core of strategic-thinking prompt engineering is not giving AI a clever command. It is telling AI how to look at the problem, what criteria to use, and how to verify the answer.

Methods such as Chain-of-Thought, Self-Consistency, Tree of Thoughts, and ReAct all point in the same direction. Do not try to solve a complex problem in one pass. Divide the problem, review multiple paths, check external evidence, and verify at the end.

People who use AI well in practice are not simply good at asking questions. More precisely, they can design the thinking structure the AI should follow. That is where the real value of prompt engineering lies.

很多人在使用 AI 时会这样提问。

告诉我这个主题。 解决这个问题。 写一篇博客文章。

这种方式在一定程度上有效。但在复杂问题中,结果常常显得浅或很普通。原因是你只告诉 AI 要做什么,却没有告诉它应该怎样思考。

近来的提示工程趋势,不只是写命令,而是把战略思维和问题解决方法放进提示词里。也就是说,不是要求 AI “只给答案”,而是要求它先定义问题、设定判断标准、比较方案、验证之后再回答。

OpenAI 的官方提示工程指南也建议使用清晰指令、提供参考资料、把复杂任务拆成子任务、给模型思考时间、使用外部工具,并系统性测试修改。这和把战略思维结构应用到提示词中的方法一致。

什么是基于战略思维的提示词

基于战略思维的提示词,不只是向 AI 请求结果,而是同时提供看待问题的框架。

普通提示词如下。

이 서비스 아이디어를 평가해줘.

可以把它改成战略思维型提示词。

다음 서비스 아이디어를 전략적 관점에서 평가해 주세요.

1. 이 아이디어가 해결하려는 핵심 문제를 정의해 주세요.

2. 주요 고객과 이해관계자를 정리해 주세요.

3. 시장성, 기술적 난이도, 수익성, 리스크를 각각 평가해 주세요.

4. 실행 가능한 MVP를 제안해 주세요.

5. 이 아이디어가 실패할 가능성이 높은 이유도 함께 제시해 주세요.

아이디어:

[내용 입력]

两者差异很明显。第一个把“评价”这个模糊任务交给 AI。第二个则把评价标准、思考顺序、检查项目和反方观点都一起指定。

关键是把 AI 当作会沿着问题解决流程工作的协作工具,而不是简单的答案生成器。

为什么有效

LLM 不会自动完美理解用户意图。它会根据用户给出的指令、上下文、例子和限制来组织输出。因此,问题越复杂,越需要明确告诉它依据什么标准判断、按照什么顺序思考。

代表性研究是 Chain-of-Thought Prompting。该研究说明,如果引导模型生成中间推理步骤,在算术、常识、符号推理等复杂问题上性能会提升,尤其在足够大的模型上效果更明显。

在提示词中加入思考流程并不是文字游戏。把复杂问题拆成小步骤,并让模型在每一步做判断,是研究中已经验证过的有效方法。

代表性的战略提示方法

1. Chain-of-Thought:让模型逐步思考

Chain-of-Thought 不是让 AI 一次性回答,而是引导它经过中间步骤再给出答案。

다음 문제를 바로 답하지 말고, 필요한 정보를 정리한 뒤 단계적으로 풀어 주세요.

마지막에는 최종 답만 따로 정리해 주세요.

这种方式适合数学题、逻辑题、原因分析和复杂比较。Google Research也说明,Chain-of-Thought 通过把多步骤问题拆成中间步骤来提升推理能力。

不过在实际工作中,比起“展示所有漫长思考过程”,更好的要求是“逐步检查,并总结结论和依据”。过长的推理过程不易阅读,也可能生成看似合理但错误的说明。

2. Self-Consistency:用多条路径检查并找到一致结论

Self-Consistency 不只接受一个答案,而是生成多个解法路径或观点,再选择最一致的结论。

이 문제를 서로 다른 접근법 3가지로 검토해 주세요.

각 접근법의 결론을 비교하고, 가장 일관된 결론을 최종 답으로 제시해 주세요.

Self-Consistency 研究报告称,通过采样多样化 reasoning path 并选择最一致的答案,可以提升复杂推理基准的表现。论文提到了 GSM8K、SVAMP、AQuA、StrategyQA、ARC-challenge 等任务。

在实务中,它适合用于推测 bug 原因、审查企划案、解释政策和检查决策。相比单一视角,多视角比较后的答案通常更稳定。

3. Tree of Thoughts:探索并评价多个选项

Tree of Thoughts 比只沿着一条思路前进的 Chain-of-Thought 更具探索性。它生成多个候选路径,评价各路径,再深入探索更有可能的路径。

이 문제를 Tree of Thoughts 방식으로 분석해 주세요.

1. 가능한 해결 전략을 3가지 제시해 주세요.

2. 각 전략의 장점, 단점, 리스크를 평가해 주세요.

3. 가장 가능성 높은 전략 1~2개를 더 깊게 분석해 주세요.

4. 최종 추천안을 제시하고 실패 가능성도 함께 정리해 주세요.

Tree of Thoughts 论文指出,传统 Chain-of-Thought 可能受限于单一的从左到右生成方式,因此提出探索多个思考路径、自我评价并在必要时回退。论文在 Game of 24、创意写作、小型填字游戏等任务中展示了效果。

这种方式适合业务战略、服务企划、技术架构选择、营销方向设定等没有唯一答案的问题。

4. ReAct:结合推理和行动

ReAct 结合了 Reasoning 和 Acting。AI 不只是思考,在需要时还会搜索、检查文档、使用工具,并根据结果更新答案。

다음 작업을 ReAct 방식으로 수행해 주세요.

1. 먼저 무엇을 확인해야 하는지 계획해 주세요.

2. 필요한 경우 웹 검색이나 문서 확인을 수행해 주세요.

3. 확인한 결과를 바탕으로 답변을 수정해 주세요.

4. 최종 답변에는 확인된 사실과 추정한 내용을 구분해 주세요.

ReAct 研究说明,让模型交替生成 reasoning trace 和 task-specific action,可以让模型规划、更新计划,并与外部知识源互动。论文在问答、事实验证、交互式决策任务中报告了效果。Google Research也说明,ReAct 通过结合推理和行动,提供了更可解释、更可控的问题解决方式。

它适合需要最新信息的研究、基于内部文档的回答、产品比较、法律和政策审查等重视依据确认的任务。

实务中可直接使用的提示模板

战略分析提示

다음 주제를 전략적 사고 방식으로 분석해 주세요.

1. 핵심 문제를 한 문장으로 정의해 주세요.

2. 이해관계자와 제약조건을 정리해 주세요.

3. 가능한 전략을 3가지 제시해 주세요.

4. 각 전략의 장점, 단점, 리스크, 실행 난이도를 비교해 주세요.

5. 가장 현실적인 전략을 추천해 주세요.

6. 이 결론이 틀릴 수 있는 조건도 함께 제시해 주세요.

주제:

[입력]

问题解决提示

다음 문제를 바로 해결하지 말고 진단부터 해 주세요.

1. 가능한 원인을 우선순위별로 나눠 주세요.

2. 각 원인을 확인하는 방법을 제시해 주세요.

3. 가장 가능성 높은 해결책부터 제안해 주세요.

4. 해결책의 부작용이나 예외 상황을 알려 주세요.

5. 마지막에 확실한 내용과 추정한 내용을 구분해 주세요.

문제:

[입력]

代码审查提示

다음 코드를 시니어 프론트엔드 개발자 관점에서 리뷰해 주세요.

검토 기준:

1. 버그 가능성

2. 성능

3. 유지보수성

4. 접근성

5. 브라우저 호환성

6. 더 단순한 구현 가능성

출력 형식:

- 가장 중요한 문제 3개

- 수정 이유

- 개선 코드

- 추가 테스트 항목

코드:

[입력]

研究提示

다음 주제를 조사해 주세요.

1. 먼저 확인해야 할 핵심 질문을 정리해 주세요.

2. 최신성과 신뢰도가 중요한 부분을 구분해 주세요.

3. 출처 기반으로 핵심 내용을 요약해 주세요.

4. 서로 다른 관점이나 반론이 있으면 함께 정리해 주세요.

5. 마지막에 실무적으로 적용 가능한 결론을 제시해 주세요.

주제:

[입력]

特别有效的场景

基于战略思维的提示词适合复杂决策。例如技术栈选择、服务方向设定、商业想法评估等需要同时考虑多个标准的问题。

它也适合原因分析。对于 bug、性能下降、销售减少、用户流失等原因不明确的问题,先拆分可能原因并确定验证顺序会很有帮助。

在企划和战略制定中也很有效。相比简单生成创意,它更适合需要问题定义、目标用户分析、执行优先级和风险审查的场景。

在研究和验证工作中,ReAct 或 RAG 风格的提示尤其有用。需要最新信息、依据、出处和反方观点时,应要求模型区分已确认事实和推测。

在代码审查和文档审查中,明确评价标准也能让 AI 更一致地发现问题。

效果较小的场景

并不是所有提示都需要复杂化。简单翻译、短句润色、简单摘要、明确事实问题,使用长战略提示反而低效。

이 문장을 자연스러운 영어로 바꿔줘.

这种任务已经足够明确,没有必要再要求问题定义、方案比较和风险分析。提示工程的目的不是写得长,而是为任务提供必要的思考结构。

有结构不代表一定正确

战略提示可以提升回答质量,但不能保证准确。AI 也可能生成结构合理但内容错误的回答。重要工作必须加入验证机制。

근거가 불확실한 내용은 추정이라고 표시해 주세요.

최신 정보가 필요한 내용은 웹 검색 기준으로 확인해 주세요.

마지막에 검증해야 할 체크리스트를 제공해 주세요.

尤其在法律、医疗、金融、安全、企业决策等高风险领域,不应直接相信 AI 答案,而应确认来源并接受专家审查。

好提示词的核心结构

基于战略思维的提示词通常包含以下结构。

역할:

AI가 어떤 관점에서 답해야 하는지 지정합니다.

목표:

무엇을 달성해야 하는지 명확히 합니다.

맥락:

상황, 배경, 대상, 제약조건을 제공합니다.

방법:

문제를 어떤 순서로 분석할지 지정합니다.

기준:

무엇을 기준으로 판단할지 알려줍니다.

출력 형식:

답변을 어떤 형태로 정리할지 정합니다.

검증:

불확실성, 반론, 추가 확인 사항을 요구합니다.

示例如下。

역할:

당신은 시니어 UX 전략가입니다.

목표:

신규 웹서비스의 랜딩페이지 전략을 검토해 주세요.

맥락:

타깃 사용자는 30대 직장인이고, 서비스는 업무 자동화 도구입니다.

방법:

1. 핵심 고객 문제를 정의해 주세요.

2. 랜딩페이지에서 가장 먼저 설득해야 할 메시지를 제안해 주세요.

3. 신뢰를 만들기 위한 요소를 정리해 주세요.

4. 전환율을 높이기 위한 CTA 구조를 제안해 주세요.

기준:

명확성, 설득력, 실행 가능성, 전환율 관점에서 평가해 주세요.

출력 형식:

- 핵심 문제

- 메시지 전략

- 페이지 구성

- CTA 제안

- 테스트해야 할 가설

使用这种结构,AI 的回答会更少发散,也更容易应用到实际工作中。

结论

基于战略思维的提示工程,核心不是给 AI 一个漂亮的命令,而是告诉它如何看待问题、用什么标准判断、用什么方式验证。

Chain-of-Thought、Self-Consistency、Tree of Thoughts、ReAct 都指向同一方向:不要试图一次性解决复杂问题,而要拆分问题、检查多条路径、确认外部依据,并在最后验证。

在实践中善用 AI 的人,不只是会提问的人。更准确地说,是能设计 AI 应该遵循的思考结构的人。提示工程真正的价值就在这里。

AI を使うとき、多くの人は次のように質問する。

このテーマについて教えて。 この問題を解決して。 ブログ記事を書いて。

この方法もある程度は機能する。しかし複雑な問題では、結果がありきたりだったり浅かったりすることが多い。AI に何をすべきかは伝えていても、どのように考えるべきかを伝えていないからだ。

近年のプロンプトエンジニアリングで重要なのは、単なる命令文ではなく、戦略的思考と問題解決の方法論をプロンプトに組み込むことだ。AI に「正解だけを言って」と頼むのではなく、「問題を定義し、基準を立て、代替案を比較し、検証してから答えて」と依頼する。

OpenAI の公式プロンプトエンジニアリングガイドも、明確な指示、参考資料の提供、複雑な作業の分解、モデルに考える時間を与えること、外部ツールの利用、変更の体系的なテストを推奨している。これは戦略的思考の構造をプロンプトに適用する考え方とつながっている。

戦略的思考ベースのプロンプトとは何か

戦略的思考ベースのプロンプトとは、AI に成果物だけを求めるのではなく、問題を見るためのフレームも一緒に与えるプロンプトだ。

一般的なプロンプトは次のようになる。

이 서비스 아이디어를 평가해줘.

これを戦略的思考ベースにすると、次のように変えられる。

다음 서비스 아이디어를 전략적 관점에서 평가해 주세요.

1. 이 아이디어가 해결하려는 핵심 문제를 정의해 주세요.

2. 주요 고객과 이해관계자를 정리해 주세요.

3. 시장성, 기술적 난이도, 수익성, 리스크를 각각 평가해 주세요.

4. 실행 가능한 MVP를 제안해 주세요.

5. 이 아이디어가 실패할 가능성이 높은 이유도 함께 제시해 주세요.

아이디어:

[내용 입력]

違いは明確だ。最初のプロンプトは「評価」という曖昧な作業を AI に任せる。二つ目は評価基準、思考の順序、検討項目、反論まで指定している。

重要なのは、AI を単なる回答生成機ではなく、問題解決プロセスに沿って動く協業ツールとして使うことだ。

なぜ効果があるのか

LLM はユーザーの意図を完全に自動解釈するわけではない。ユーザーが与えた指示、文脈、例、制約条件に従って出力を構成する。したがって複雑な問題ほど、どの基準で判断し、どの順序で考えるべきかを明確に伝えることが重要になる。

代表的な研究が Chain-of-Thought Prompting だ。この研究は、モデルに中間推論ステップを生成させると、算術、常識、記号推論のような複雑な問題で性能が向上すると説明している。特に十分に大きなモデルで効果が目立つと報告された。

プロンプトに思考手順を入れることは単なる言葉遊びではない。複雑な問題を小さな段階に分け、各段階で判断させる方法は、実際の研究でも効果が確認されている。

代表的な戦略的プロンプト手法

1. Chain-of-Thought:段階的に考えさせる

Chain-of-Thought は、AI に問題を一度で解かせるのではなく、中間段階を経て答えさせる方法だ。

다음 문제를 바로 답하지 말고, 필요한 정보를 정리한 뒤 단계적으로 풀어 주세요.

마지막에는 최종 답만 따로 정리해 주세요.

この方法は数学問題、論理問題、原因分析、複雑な比較に向いている。Google Researchも、Chain-of-Thought が多段階問題を中間ステップに分解させ、reasoning 能力を改善すると説明している。

ただし実務では「すべての思考過程を長く見せて」よりも、「段階的に検討し、結論と根拠を要約して」のほうがよい。長い推論過程は読みづらく、もっともらしいが誤った説明を作ることもある。

2. Self-Consistency:複数の経路で検討し、一貫した結論を探す

Self-Consistency は一つの回答だけを受け取るのではなく、複数の解法や観点を作り、最も一貫した結論を選ぶ方法だ。

이 문제를 서로 다른 접근법 3가지로 검토해 주세요.

각 접근법의 결론을 비교하고, 가장 일관된 결론을 최종 답으로 제시해 주세요.

Self-Consistency の研究は、多様な reasoning path をサンプリングし、最も一貫した答えを選ぶ方法が複雑な推論ベンチマークで性能を高めたと報告している。論文では GSM8K、SVAMP、AQuA、StrategyQA、ARC-challenge などで改善が示された。

実務ではバグ原因の推定、企画案のレビュー、政策解釈、意思決定の検討に役立つ。一つの観点で出た答えより、複数の観点を比較した答えのほうが安定しやすい。

3. Tree of Thoughts:複数の選択肢を探索し評価する

Tree of Thoughts は、一つの思考の流れを追う Chain-of-Thought より探索的な方法だ。複数の候補経路を作り、それぞれを評価し、有望な経路をさらに深く探索する。

이 문제를 Tree of Thoughts 방식으로 분석해 주세요.

1. 가능한 해결 전략을 3가지 제시해 주세요.

2. 각 전략의 장점, 단점, 리스크를 평가해 주세요.

3. 가장 가능성 높은 전략 1~2개를 더 깊게 분석해 주세요.

4. 최종 추천안을 제시하고 실패 가능성도 함께 정리해 주세요.

Tree of Thoughts 論文は、既存の Chain-of-Thought が一つの左から右への逐次生成に制限される可能性を指摘し、複数の思考経路を探索し、自ら評価し、必要なら戻る方法を提案した。Game of 24、創造的文章作成、ミニクロスワードなどで効果が示された。

この方法は事業戦略、サービス企画、技術アーキテクチャ選択、マーケティング方針のように、正解が一つに定まらない問題によく合う。

4. ReAct:推論と行動を組み合わせる

ReAct は Reasoning と Acting を組み合わせる方法だ。AI は考えるだけでなく、必要に応じて検索、文書確認、ツール利用を行い、その結果をもとに答えを更新する。

다음 작업을 ReAct 방식으로 수행해 주세요.

1. 먼저 무엇을 확인해야 하는지 계획해 주세요.

2. 필요한 경우 웹 검색이나 문서 확인을 수행해 주세요.

3. 확인한 결과를 바탕으로 답변을 수정해 주세요.

4. 최종 답변에는 확인된 사실과 추정한 내용을 구분해 주세요.

ReAct の研究は、reasoning trace と task-specific action を交互に生成させることで、モデルが計画し、更新し、外部知識源と相互作用できると説明している。質問応答、事実検証、対話的意思決定で効果が報告された。Google Researchも、ReAct は推論と行動を組み合わせることで、より解釈可能で制御しやすい問題解決を提供すると説明している。

最新情報が必要なリサーチ、内部文書に基づく回答、製品比較、法律や政策の確認のように、根拠確認が重要な作業に適している。

実務ですぐ使えるプロンプトテンプレート

戦略分析用プロンプト

다음 주제를 전략적 사고 방식으로 분석해 주세요.

1. 핵심 문제를 한 문장으로 정의해 주세요.

2. 이해관계자와 제약조건을 정리해 주세요.

3. 가능한 전략을 3가지 제시해 주세요.

4. 각 전략의 장점, 단점, 리스크, 실행 난이도를 비교해 주세요.

5. 가장 현실적인 전략을 추천해 주세요.

6. 이 결론이 틀릴 수 있는 조건도 함께 제시해 주세요.

주제:

[입력]

問題解決用プロンプト

다음 문제를 바로 해결하지 말고 진단부터 해 주세요.

1. 가능한 원인을 우선순위별로 나눠 주세요.

2. 각 원인을 확인하는 방법을 제시해 주세요.

3. 가장 가능성 높은 해결책부터 제안해 주세요.

4. 해결책의 부작용이나 예외 상황을 알려 주세요.

5. 마지막에 확실한 내용과 추정한 내용을 구분해 주세요.

문제:

[입력]

コードレビュー用プロンプト

다음 코드를 시니어 프론트엔드 개발자 관점에서 리뷰해 주세요.

검토 기준:

1. 버그 가능성

2. 성능

3. 유지보수성

4. 접근성

5. 브라우저 호환성

6. 더 단순한 구현 가능성

출력 형식:

- 가장 중요한 문제 3개

- 수정 이유

- 개선 코드

- 추가 테스트 항목

코드:

[입력]

リサーチ用プロンプト

다음 주제를 조사해 주세요.

1. 먼저 확인해야 할 핵심 질문을 정리해 주세요.

2. 최신성과 신뢰도가 중요한 부분을 구분해 주세요.

3. 출처 기반으로 핵심 내용을 요약해 주세요.

4. 서로 다른 관점이나 반론이 있으면 함께 정리해 주세요.

5. 마지막에 실무적으로 적용 가능한 결론을 제시해 주세요.

주제:

[입력]

特に効果的な状況

戦略的思考ベースのプロンプトは複雑な意思決定に効果的だ。技術スタック選択、サービス方針、事業アイデア検討のように、複数の基準を同時に考える問題で役立つ。

原因分析にもよく合う。バグ、性能低下、売上減少、ユーザー離脱のように原因が一つに明確でない問題では、可能性を分けて検証順序を決めることが助けになる。

企画や戦略立案でも効果が大きい。単純なアイデア生成よりも、問題定義、ターゲット分析、実行優先度、リスク検討が必要な場合に向いている。

リサーチと検証では、ReAct や RAG 型のプロンプトが特に有用だ。最新情報、根拠、出典、反論が必要な作業では、確認済みの事実と推測を分けるよう依頼するべきだ。

コードレビューや文書レビューでも、検討基準を明確にすると AI はより一貫して問題を見つけられる。

効果が小さい状況

すべてのプロンプトを複雑にする必要はない。単純な翻訳、短い文章の修正、簡単な要約、明確な事実質問には、長い戦略プロンプトはかえって非効率だ。

이 문장을 자연스러운 영어로 바꿔줘.

この程度で十分な作業に、問題定義、代替案比較、リスク分析まで求める必要はない。プロンプトエンジニアリングの目的は長く書くことではなく、作業に必要な思考構造を正確に与えることだ。

構造があるからといって常に正しいわけではない

戦略的プロンプトは回答品質を上げられるが、正確性を保証するものではない。AI は論理的な形式を持つ誤答も作れる。重要な作業では必ず検証を入れるべきだ。

근거가 불확실한 내용은 추정이라고 표시해 주세요.

최신 정보가 필요한 내용은 웹 검색 기준으로 확인해 주세요.

마지막에 검증해야 할 체크리스트를 제공해 주세요.

法律、医療、金融、セキュリティ、企業意思決定のようなリスクが高い領域では、AI の回答をそのまま信じるのではなく、出典確認と専門家レビューが必要だ。

良いプロンプトの核心構造

戦略的思考ベースのプロンプトは、概ね次の構造を持つ。

역할:

AI가 어떤 관점에서 답해야 하는지 지정합니다.

목표:

무엇을 달성해야 하는지 명확히 합니다.

맥락:

상황, 배경, 대상, 제약조건을 제공합니다.

방법:

문제를 어떤 순서로 분석할지 지정합니다.

기준:

무엇을 기준으로 판단할지 알려줍니다.

출력 형식:

답변을 어떤 형태로 정리할지 정합니다.

검증:

불확실성, 반론, 추가 확인 사항을 요구합니다.

例は次のとおり。

역할:

당신은 시니어 UX 전략가입니다.

목표:

신규 웹서비스의 랜딩페이지 전략을 검토해 주세요.

맥락:

타깃 사용자는 30대 직장인이고, 서비스는 업무 자동화 도구입니다.

방법:

1. 핵심 고객 문제를 정의해 주세요.

2. 랜딩페이지에서 가장 먼저 설득해야 할 메시지를 제안해 주세요.

3. 신뢰를 만들기 위한 요소를 정리해 주세요.

4. 전환율을 높이기 위한 CTA 구조를 제안해 주세요.

기준:

명확성, 설득력, 실행 가능성, 전환율 관점에서 평가해 주세요.

출력 형식:

- 핵심 문제

- 메시지 전략

- 페이지 구성

- CTA 제안

- 테스트해야 할 가설

この構造を使うと、AI の回答は散らばりにくくなり、実務に適用しやすい形で整理される。

結論

戦略的思考ベースのプロンプトエンジニアリングの核心は、AI に気の利いた命令を投げることではない。問題をどう見て、どの基準で判断し、どの方法で検証するかを伝えることだ。

Chain-of-Thought、Self-Consistency、Tree of Thoughts、ReAct はすべて同じ方向を示している。複雑な問題を一度に解決しようとせず、問題を分け、複数の経路を検討し、外部根拠を確認し、最後に検証するということだ。

実務で AI をうまく使う人は、単に質問がうまい人ではない。より正確には、AI が従うべき思考構造を設計できる人だ。プロンプトエンジニアリングの本当の価値はそこにある。

Cuando muchas personas usan IA, preguntan algo así.

Cuéntame sobre este tema. Resuelve este problema. Escribe una entrada de blog.

Este enfoque funciona hasta cierto punto. Pero en problemas complejos, el resultado suele ser obvio o superficial. La razón es que se le dijo a la IA qué hacer, pero no cómo debía pensar.

Una corriente importante en la ingeniería de prompts reciente no consiste solo en escribir instrucciones, sino en incorporar pensamiento estratégico y métodos de resolución de problemas dentro del prompt. En vez de pedir "dame solo la respuesta", se pide "define el problema, establece criterios, compara alternativas, verifica y luego responde".

La guía oficial de prompt engineering de OpenAI también recomienda instrucciones claras, material de referencia, dividir tareas complejas en subtareas, dar tiempo al modelo para pensar, usar herramientas externas y probar los cambios de forma sistemática. Esto conecta con aplicar la estructura del pensamiento estratégico a los prompts.

Qué es un prompt basado en pensamiento estratégico

Un prompt basado en pensamiento estratégico no solo pide un resultado a la IA. También le ofrece un marco para observar el problema.

Un prompt común sería este.

이 서비스 아이디어를 평가해줘.

Un prompt estratégico puede transformarlo así.

다음 서비스 아이디어를 전략적 관점에서 평가해 주세요.

1. 이 아이디어가 해결하려는 핵심 문제를 정의해 주세요.

2. 주요 고객과 이해관계자를 정리해 주세요.

3. 시장성, 기술적 난이도, 수익성, 리스크를 각각 평가해 주세요.

4. 실행 가능한 MVP를 제안해 주세요.

5. 이 아이디어가 실패할 가능성이 높은 이유도 함께 제시해 주세요.

아이디어:

[내용 입력]

La diferencia es clara. El primero delega una tarea vaga llamada "evaluar". El segundo especifica criterios, orden de pensamiento, puntos de revisión e incluso objeciones.

La idea central es usar la IA como una herramienta colaborativa que sigue un proceso de resolución de problemas, no como un simple generador de respuestas.

Por qué funciona

Los LLM no interpretan perfectamente la intención del usuario por sí solos. Construyen la salida según instrucciones, contexto, ejemplos y restricciones. Por eso, cuanto más complejo es el problema, más importante es indicar con qué criterios juzgar y en qué orden razonar.

Un estudio representativo es Chain-of-Thought Prompting. Explica que inducir al modelo a generar pasos intermedios de razonamiento mejora el rendimiento en problemas complejos como aritmética, sentido común y razonamiento simbólico, especialmente en modelos suficientemente grandes.

Incluir un procedimiento de pensamiento en el prompt no es un juego de palabras. Dividir un problema complejo en pasos pequeños y pedir que el modelo evalúe cada paso es un enfoque cuya eficacia se ha observado en investigación.

Métodos representativos de prompts estratégicos

1. Chain-of-Thought: hacer que piense paso a paso

Chain-of-Thought guía a la IA para que no resuelva un problema de una sola vez, sino mediante pasos intermedios.

다음 문제를 바로 답하지 말고, 필요한 정보를 정리한 뒤 단계적으로 풀어 주세요.

마지막에는 최종 답만 따로 정리해 주세요.

Es útil para matemáticas, lógica, análisis de causas y comparaciones complejas. Google Research también explica que Chain-of-Thought mejora el razonamiento al hacer que el modelo descomponga problemas de varios pasos.

En la práctica, sin embargo, suele ser mejor pedir "revisa por etapas y resume la conclusión y la evidencia" que "muéstrame todo el proceso de pensamiento". Un razonamiento demasiado largo es difícil de leer y puede producir explicaciones plausibles pero incorrectas.

2. Self-Consistency: revisar por varias rutas y encontrar una conclusión consistente

Self-Consistency no se queda con una sola respuesta. Genera varios caminos de solución o perspectivas y selecciona la conclusión más consistente.

이 문제를 서로 다른 접근법 3가지로 검토해 주세요.

각 접근법의 결론을 비교하고, 가장 일관된 결론을 최종 답으로 제시해 주세요.

El estudio de Self-Consistency informó que muestrear distintos reasoning paths y elegir la respuesta más consistente mejora el rendimiento en benchmarks de razonamiento complejo, como GSM8K, SVAMP, AQuA, StrategyQA y ARC-challenge.

En el trabajo real, sirve para estimar causas de bugs, revisar planes, interpretar políticas y analizar decisiones. Una respuesta que compara varias perspectivas suele ser más estable que una obtenida desde una sola.

3. Tree of Thoughts: explorar y evaluar varias opciones

Tree of Thoughts es más exploratorio que Chain-of-Thought. Genera varias rutas candidatas, evalúa cada una y profundiza en las más prometedoras.

이 문제를 Tree of Thoughts 방식으로 분석해 주세요.

1. 가능한 해결 전략을 3가지 제시해 주세요.

2. 각 전략의 장점, 단점, 리스크를 평가해 주세요.

3. 가장 가능성 높은 전략 1~2개를 더 깊게 분석해 주세요.

4. 최종 추천안을 제시하고 실패 가능성도 함께 정리해 주세요.

El paper de Tree of Thoughts señala que Chain-of-Thought puede estar limitado por una generación secuencial de izquierda a derecha, y propone explorar múltiples rutas, autoevaluarlas y retroceder si hace falta. Mostró efectos en Game of 24, escritura creativa y mini crucigramas.

Este método encaja con estrategia de negocio, planificación de servicios, elección de arquitectura técnica y dirección de marketing, donde no existe una única respuesta correcta.

4. ReAct: combinar razonamiento y acción

ReAct combina Reasoning y Acting. La IA no solo piensa; cuando hace falta, busca, revisa documentos, usa herramientas y actualiza la respuesta con esos resultados.

다음 작업을 ReAct 방식으로 수행해 주세요.

1. 먼저 무엇을 확인해야 하는지 계획해 주세요.

2. 필요한 경우 웹 검색이나 문서 확인을 수행해 주세요.

3. 확인한 결과를 바탕으로 답변을 수정해 주세요.

4. 최종 답변에는 확인된 사실과 추정한 내용을 구분해 주세요.

El estudio ReAct explica que alternar reasoning trace y task-specific action permite al modelo planificar, actualizarse e interactuar con fuentes externas de conocimiento. El paper reportó efectos en preguntas y respuestas, verificación de hechos y decisiones interactivas. Google Research también explica que ReAct ofrece una resolución de problemas más interpretable y controlable al combinar razonamiento y acción.

Es adecuado para investigación con información reciente, respuestas basadas en documentos internos, comparación de productos y revisión legal o de políticas, donde la verificación de evidencia importa.

Plantillas de prompts listas para usar

Prompt de análisis estratégico

다음 주제를 전략적 사고 방식으로 분석해 주세요.

1. 핵심 문제를 한 문장으로 정의해 주세요.

2. 이해관계자와 제약조건을 정리해 주세요.

3. 가능한 전략을 3가지 제시해 주세요.

4. 각 전략의 장점, 단점, 리스크, 실행 난이도를 비교해 주세요.

5. 가장 현실적인 전략을 추천해 주세요.

6. 이 결론이 틀릴 수 있는 조건도 함께 제시해 주세요.

주제:

[입력]

Prompt para resolver problemas

다음 문제를 바로 해결하지 말고 진단부터 해 주세요.

1. 가능한 원인을 우선순위별로 나눠 주세요.

2. 각 원인을 확인하는 방법을 제시해 주세요.

3. 가장 가능성 높은 해결책부터 제안해 주세요.

4. 해결책의 부작용이나 예외 상황을 알려 주세요.

5. 마지막에 확실한 내용과 추정한 내용을 구분해 주세요.

문제:

[입력]

Prompt para revisión de código

다음 코드를 시니어 프론트엔드 개발자 관점에서 리뷰해 주세요.

검토 기준:

1. 버그 가능성

2. 성능

3. 유지보수성

4. 접근성

5. 브라우저 호환성

6. 더 단순한 구현 가능성

출력 형식:

- 가장 중요한 문제 3개

- 수정 이유

- 개선 코드

- 추가 테스트 항목

코드:

[입력]

Prompt para investigación

다음 주제를 조사해 주세요.

1. 먼저 확인해야 할 핵심 질문을 정리해 주세요.

2. 최신성과 신뢰도가 중요한 부분을 구분해 주세요.

3. 출처 기반으로 핵심 내용을 요약해 주세요.

4. 서로 다른 관점이나 반론이 있으면 함께 정리해 주세요.

5. 마지막에 실무적으로 적용 가능한 결론을 제시해 주세요.

주제:

[입력]

Situaciones en las que es especialmente útil

Los prompts basados en pensamiento estratégico son eficaces para decisiones complejas. Ayudan en selección de stack tecnológico, dirección de producto o evaluación de ideas de negocio, donde hay que considerar varios criterios a la vez.

También encajan con análisis de causas. En bugs, caídas de rendimiento, disminución de ventas o abandono de usuarios, ayuda separar posibles causas y definir un orden de verificación.

En planificación y estrategia también son fuertes. Son adecuados cuando se necesita definir el problema, analizar el público, ordenar prioridades de ejecución y revisar riesgos.

Para investigación y verificación, los prompts de estilo ReAct o RAG son especialmente útiles. Cuando importan actualidad, evidencia, fuentes y contraargumentos, conviene pedir que se distingan hechos confirmados y suposiciones.

En revisión de código y documentación, dar criterios claros hace que la IA encuentre problemas de forma más consistente.

Situaciones en las que aporta menos

No hace falta complicar todos los prompts. Para traducción simple, corrección breve, resúmenes sencillos o preguntas factuales claras, un prompt estratégico largo puede ser ineficiente.

이 문장을 자연스러운 영어로 바꿔줘.

Para una tarea así, no hace falta pedir definición del problema, comparación de alternativas y análisis de riesgos. El objetivo de la ingeniería de prompts no es escribir más, sino ofrecer la estructura de pensamiento que la tarea necesita.

Tener estructura no garantiza que sea correcto

Un prompt estratégico puede mejorar la calidad, pero no garantiza exactitud. La IA puede producir respuestas equivocadas con forma lógica. En trabajos importantes, se debe incluir verificación.

근거가 불확실한 내용은 추정이라고 표시해 주세요.

최신 정보가 필요한 내용은 웹 검색 기준으로 확인해 주세요.

마지막에 검증해야 할 체크리스트를 제공해 주세요.

En áreas de alto riesgo como derecho, salud, finanzas, seguridad y decisiones empresariales, no conviene confiar en la respuesta de la IA tal cual. Se necesitan fuentes y revisión experta.

Estructura central de un buen prompt

Un prompt basado en pensamiento estratégico suele tener esta estructura.

역할:

AI가 어떤 관점에서 답해야 하는지 지정합니다.

목표:

무엇을 달성해야 하는지 명확히 합니다.

맥락:

상황, 배경, 대상, 제약조건을 제공합니다.

방법:

문제를 어떤 순서로 분석할지 지정합니다.

기준:

무엇을 기준으로 판단할지 알려줍니다.

출력 형식:

답변을 어떤 형태로 정리할지 정합니다.

검증:

불확실성, 반론, 추가 확인 사항을 요구합니다.

Ejemplo:

역할:

당신은 시니어 UX 전략가입니다.

목표:

신규 웹서비스의 랜딩페이지 전략을 검토해 주세요.

맥락:

타깃 사용자는 30대 직장인이고, 서비스는 업무 자동화 도구입니다.

방법:

1. 핵심 고객 문제를 정의해 주세요.

2. 랜딩페이지에서 가장 먼저 설득해야 할 메시지를 제안해 주세요.

3. 신뢰를 만들기 위한 요소를 정리해 주세요.

4. 전환율을 높이기 위한 CTA 구조를 제안해 주세요.

기준:

명확성, 설득력, 실행 가능성, 전환율 관점에서 평가해 주세요.

출력 형식:

- 핵심 문제

- 메시지 전략

- 페이지 구성

- CTA 제안

- 테스트해야 할 가설

Con esta estructura, la respuesta de la IA se dispersa menos y queda en una forma más fácil de aplicar al trabajo real.

Conclusión

La idea central de la ingeniería de prompts con pensamiento estratégico no es lanzar una instrucción elegante a la IA. Es decirle cómo mirar el problema, con qué criterios juzgar y cómo verificar.

Chain-of-Thought, Self-Consistency, Tree of Thoughts y ReAct apuntan en la misma dirección: no intentes resolver problemas complejos de una sola vez. Divide el problema, revisa varias rutas, confirma evidencia externa y verifica al final.

Quienes usan bien la IA en el trabajo no solo hacen buenas preguntas. Más precisamente, saben diseñar la estructura de pensamiento que la IA debe seguir. Ahí está el verdadero valor de la ingeniería de prompts.